Science/Research 詳細

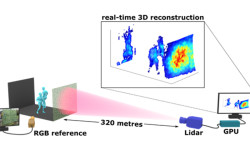

長距離から複雑なシーンをリアルタイム3D再構成

December, 24, 2019, Santa Cruz--ヘリオットワット大学(Heriot-Watt University)の研究者はトゥルーズ大学(University of Toulouse)の研究者と協力して、統計モデルとコンピュータグラフィクス界からの拡張性の高い計算ツールを統合する新しいフレームワークを提案している。狙いはリアルタイムで3D情報を抽出することである(50 fps)。

その新しい方法により、標的の検出、雑然としたシーンを通したイメージング、複雑な動くシーンのロバストな、リアルタイムターゲット再構成が可能になる。これは、次世代無人走行車の重要技術、長距離の自動車センシングに必要なイベントセンシング技術の先駆者となる。

3Dシーンの再構成には、われわれの現在および未来を形作る多くの重要なアプリケーションがある、例えば自律走行車環境モニタリング、防衛である。

ヘリオットワットの研究チームは、Nature Communicationsにリアルタイム画像再構成について画期的な新しい成果を発表した。

工学・物理学、RAEng研究フェロー、Dr. Yoann Altmannは、「フォトニクス、統計的画像処理とコンピュータグラフィクスツールを統合したこの研究は、多くの学問領域にわたる研究でいかに大きな飛躍が可能であるかを示している」とコメントしている。

初期的なレーザベースレーダ、つまりLiDAR技術は、現在、最新世代自動車で、距離、隣接車両、他の潜在的障害物の評価に利用されつつある。

ヘリオットワットは、最先端の時間相関シングルフォトンカウンティングLiDARアプローチの利用を開発した。これは、既存のアプローチに対していくつかの利点があり、アイセーフレーザの利用、長距離(数100メートル~km)で優れた分解能が可能になる。

先ごろ、この技術を利用して、過酷環境で高解像度3D画像の再構成に成功した。霧、乱雑なターゲット、高散乱水中媒体、10km以上の自由空間などである。

とは言え、これまでは、大きな障害は、記録されたデータの解析に膨大な時間がかかったことであった。個別の次元シングルフォトン検出イベントから3D情報を再生することは、集中的な画像処理アルゴリズムを必要とする厳しい作業である。以前の方法は、一つのLiDARフレーム処理に数10秒、つまり数分必要だった。再生するシーンに限定的な推定を課し、実用的な3Dイメージングアプリケーションを阻害していたからである。

研究成果は、Nature Communicationsに発表された。

(詳細は、https://www.hw.ac.uk/)